Discussion

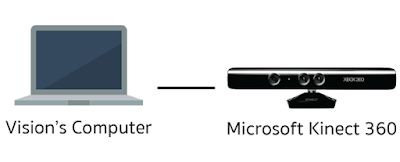

Discussion จากการออกแบบเพื่อให้หุ่นยนต์ ABB YUMI สามารถหยิบวัตถุที่มีความแตกต่างกันทั้งสีและรูปร่างทรงเรขาคณิต เพื่อนำมาประกอบเป็นชิ้นงานตามโจทย์ที่มนุษย์หรือผู้ใช้เป็นผู้กำหนด ในโปรเจคนี้วัตถุที่ใช้เป็นบล็อคไม้ที่มีรูปร่างแตกต่างกัน 2 แบบ คือ ทรงสามเหลี่ยมด้านเท่ากับทรงสี่เหลี่ยมผืนผ้า และมีสีแตกต่างกัน 7 สี ได้แก่ สีแดง สีส้ม สีน้ำเงิน สีเขียวเข้ม สีเขียวอ่อน สีม่วง และสีเหลือง การทดสอบการทำงานระหว่างผู้ใช้กับหุ่นยนต์ YUMI ได้ผลดังนี้ เมื่อผู้ใช้ทำการเลือกรูปร่าง สี เลเยอร์ และตำแหน่งของวัตถุที่ต้องการประกอบชิ้นงานให้เป็นรูปร่างต่าง ๆ ที่ต้องการ ผ่านทางหน้าจอคอมพิวเตอร์ที่เป็นส่วนของ Task Planning แล้วกดส่ง คำสั่งดังกล่าวจะถูกส่งไปยังคอมพิวเตอร์ 2 ตัว คือส่วนของ Vision ซึ่งทำหน้าที่ในการตรวจหาวัตถุที่มีสี รูปร่างตามที่ผู้ใช้กำหนด และ Manipulator ซึ่งทำหน้าที่ในการหยิบและเคลื่อนย้ายวัตถุจากจุดเริ่มต้นไปยังตำแหน่งปลายทางที่โปรแกรมไว้ ผลการทดสอบพบว่า ระบบ Vision สามารถตรวจหาสีและรูปร่างของวัตตุที่ต้องการได้อย่างถูกต้อง...